Hoy en día, las tecnologías de la inteligencia artificial (IA) permiten realizar acciones complejas imitando procesos humanos, como el aprendizaje o el razonamiento lógico.

Con ellas, se puede, por ejemplo, modificar la imagen e incluso la voz de una persona en un vídeo, con la consiguiente inquietud por los riesgos que esto supone, cuando ello se realiza fraudulentamente, o contra una persona, donde en la mayoría de los casos, la víctima ignora el proceso seguido contra ello, con todas las consecuencias que se pueden irrogar a la personalidad y también a la dignidad de la persona, especialmente contra mujeres y menores.

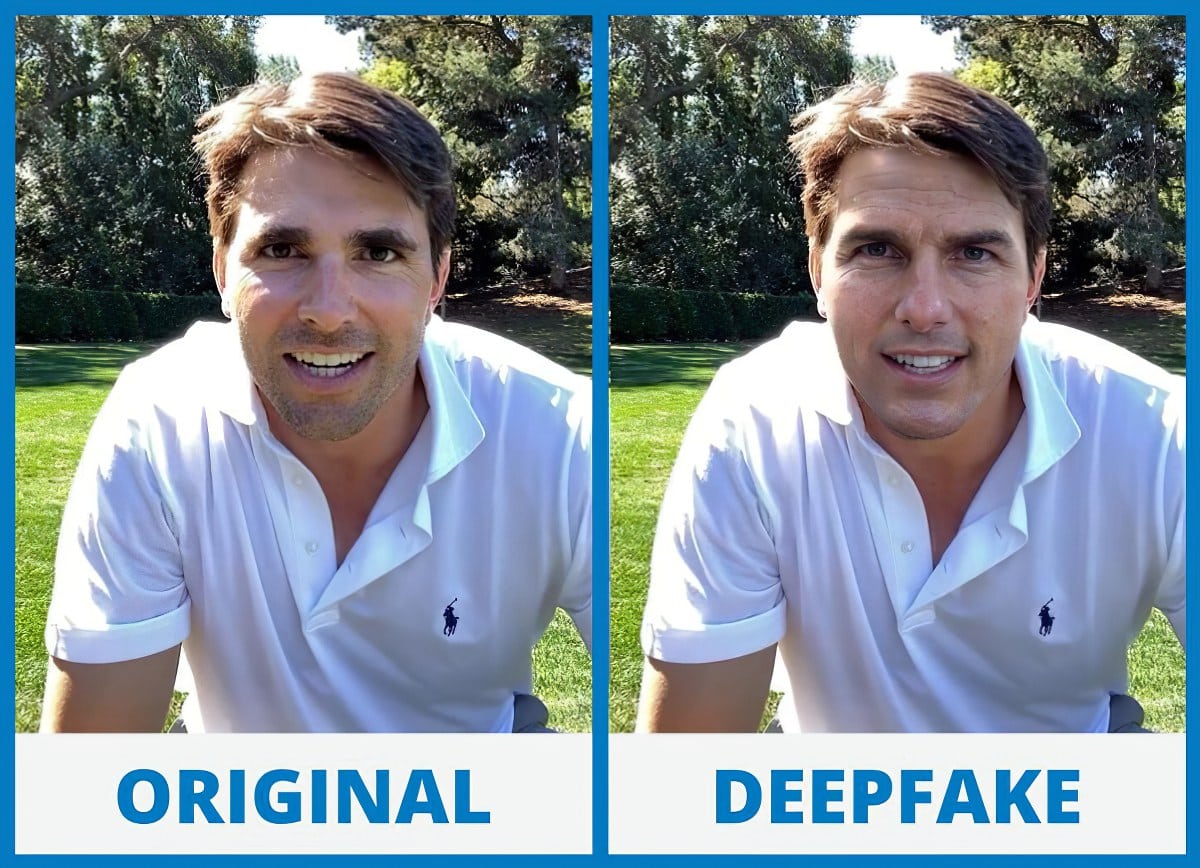

Los deepfakes son vídeos manipulados para hacer creer a los usuarios que ven a una determinada persona, tanto si es anónima como si es personaje público, realizando declaraciones o acciones que nunca ocurrieron.

Para la creación de dichos vídeos, se utilizan herramientas o programas dotados de tecnología de inteligencia artificial que permiten el intercambio de rostros en imágenes y la modificación de la voz.

Tal como se señala en Wikipedia, esta técnica se popularizó por la creación de contenido falsificado en el que un actor o personaje del espectáculo aparecía participando en un vídeo pornográfico realizando actos sexuales.

En esta modalidad de vídeos falsos, éstos son creados mediante la combinación de un vídeo pornográfico (que es utilizado como referente para el algoritmo) más otro vídeo o imagen del actor o personaje, el cual es procesado por el programa informático con técnicas deepfake. No importa que el actor o personaje nunca haya realizado escenas o vídeos pornográficos, precisamente lo que se persigue es crear el efecto, lo más realista posible, de que algo así ha ocurrido.

Debido a la abundancia de contenido pornográfico que existe en Internet, los vídeos deepfake acostumbran a crear falsificaciones pornográficas de celebridades aunque cabe resaltar que también son usados para falsificar noticias y crear bulos malintencionados.

Esta tecnología emergente vio su origen en el mundo de la investigación con aplicaciones prácticas en el mundo del cine como una alternativa a los procesos construcciones digitales que tienden a generar altos costos.

Consecuentemente con ello, se puede afirmar que un deepfake es un video, una imagen o un audio generado que imita la apariencia y el sonido de una persona. También llamados «medios sintéticos», son tan convincentes a la hora de imitar lo real que pueden engañar tanto a las personas como a los algoritmos.

CÓMO SE HACEN LOS «DEEPFAKES»

Los «deepfakes» son generados por la IA en directo, y sus formas más comunes de aplicación son en videos o como filtros de realidad aumentada

“Deepfake” como término proviene de la combinación de las palabras «deep learning» y «fake», para representar algo falso que es resultado de la tecnología de aprendizaje profundo.

La palabra «deepfake» es un término combinado de «deep learning» y «fake«, es decir:

a). «Deep learning» o aprendizaje profundo hace referencia a una de las ramas de la inteligencia artificial.

b). «Fake» o falso, hace referencia a la elaboración de falacias en la red, del mismo modo que las fake news[iii].

Podríamos definir de manera sencilla los «deepfakes» como vídeos manipulados para hacer creer a los usuarios que los ven que una determinada persona, tanto si es anónima como si es personaje público, realiza declaraciones o acciones que nunca ocurrieron.

Para la creación de dichos vídeos, se utilizan herramientas o programas dotados de tecnología de inteligencia artificial que permiten el intercambio de rostros en imágenes y la modificación de la voz.

Los vídeos hiperrealistas falsos afectan principalmente a las mujeres.

Según Sensity AI, una compañía de investigación que rastrea vídeos hiperrealistas falsos en internet, entre el 90% y el 95% de ellos son pornografía sin consentimiento y nueve de cada 10 de estos se refieren a mujeres.

Es problema se considera como un claro ejemplo de violencia machista.

El Instituto Europeo para la Igualdad de Género también lo considera así e incluye estas creaciones en su informe sobre ciber violencia contra las mujeres como una forma más de agresión machista.

DOS TIPOS DE «DEEPFAKES»

Según lo anterior, podemos identificar dos tipos de «deepfakes»:

a). «Deepface»: en este caso, se trata de superponer el rostro de una persona en la de otra y falsificar sus gestos. En algunos casos, el resultado es tan realista que resulta muy difícil identificar el engaño o fraude.

b). «Deepvoice«: en este otro caso se trataría de unir frases y palabras sueltas utilizadas por una persona para crear un discurso. Incluso, es capaz de clonar la voz original a partir de estos fragmentos

En lo referente a las razones que hace peligrosos a los deepfakes se centran fundamentalmente en el hecho de que a través de los mismos se tergiversan de forma convincente la realidad, ya que los deepfakes entrañan varios peligros, como el fraude en línea, la desinformación, los engaños y el porno de venganza.

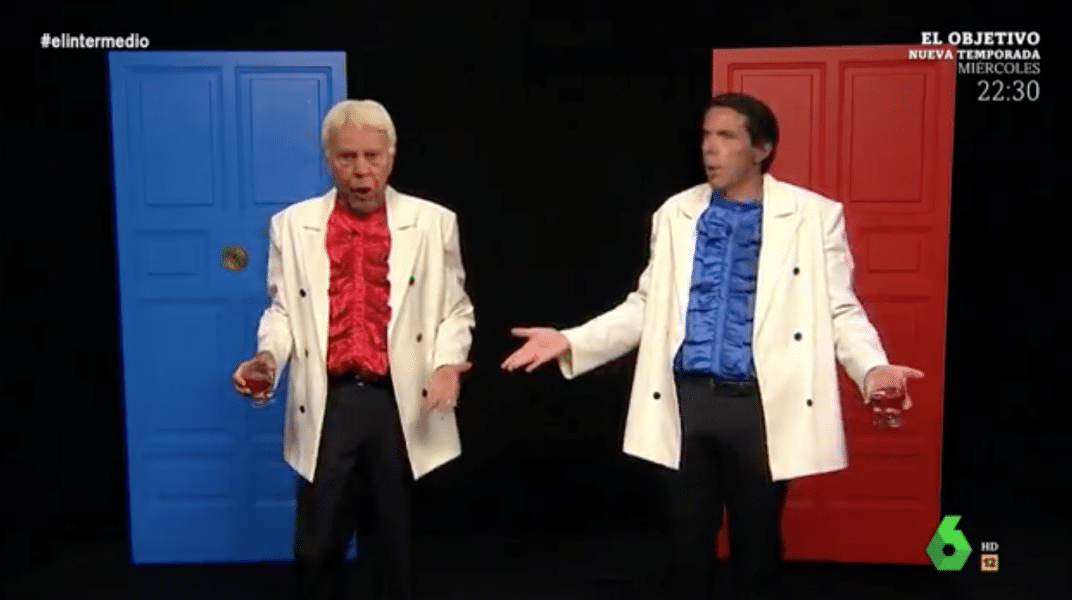

Es cierto, que no todas las aplicaciones de deepfakes son peligrosas o de dudosa naturaleza legal y ética.

Incluso puede afirmarse, que, de hecho, la mayoría de los ejemplos conocidos son populares en el ámbito del entretenimiento y como medio para expresar la creatividad.

Sin embargo, la capacidad de hacerse pasar por una persona en un video en directo o por teléfono va a suponer un reto para los sistemas de verificación en línea, que se basan en el reconocimiento de la cara o de la voz, ya sea hecho por un humano o automáticamente por un software.

Hoy en día, tal como se hace eco SEON[I], un 96% de los deepfakes en formato de video, que los investigadores de la empresa de Ámsterdam Deeptrace pudieron identificar en línea eran videos porno.

Esto podría parecer relativamente inofensivo en comparación con el fraude financiero, pero no lo es si se tiene en cuenta que puede conducir a la extorsión y el chantaje, con el creador del deepfake amenazando con publicar un video privado falso de alguien, que parece tan creíble que la víctima no tiene más remedio que pagar.

Otro problema destacado por periodistas e investigadores, es el potencial de los deepfakes para causar daños políticos y sociales a través de la desinformación y los escándalos falsos, ya que la imagen de un personaje público puede ser manipulada para mostrarlo haciendo o diciendo cosas que nunca hizo.

En este sentido, no hay que olvidar que la tecnología «deepfake» utiliza algoritmos de aprendizaje profundo, que pueden aprender por si mismos, y además, resolver problemas cuando se dispone de una amplia entrada de información mediante la entrada de datos.

Así, de esta manera, se puede utilizar esta técnica para intercambiar caras humanas en el video, y al mismo tiempo, reproducir de una manera muy aproximada, la voz original de la persona, haciendo creer de manera efectiva a los espectadores que se trata realmente de la voz original de dicha persona.

Por ello se hace necesario descubrir de manera real y efectiva que estamos en presencia de un «deepfake», y no del video y la voz de una persona concreta y determinada, la cual ha sido grabada.

CÓMO DESCUBRIR UN FRAUDE DE «DEEPFAKE»

Consecuentemente es necesario descubrir dicho fraude, y para ello se hace necesario examinar la forma de detección de los deepfakes, en los que de manera habitual se indica, que tanto si se trata de un video, como de una imagen, hay algunas elementos a las que hay que prestar una especial atención, a los efectos de detectar que se trata efectivamente de un «deepfake».

De este modo, cabe interpretar que estamos en presencia de un «deepfake», si detectamos en el vídeo, o la imagen, algunos de los siguientes elementos:

a). La existencia de incongruencias en la piel (demasiado lisa o, por el contrario, arrugada, o su edad parece desviada en comparación con el cabello).

b). O de sombras apagadas alrededor de los ojos

c). O de errores de deslumbramiento en las gafas.

d) O de vello facial de aspecto poco realista.

e). O de lunares faciales poco realistas

f). O la existencia de demasiado o de muy poco parpadeo.

g). Cuando el color de los labios fuera de lugar en comparación con la cara.

h). La existencia de un movimiento poco realista de y alrededor de la boca.

a). Buscar fondos, formas distorsionadas o sombras que no cuadren con el tipo de iluminación.

b). Es necesario determinar la existencia de cualquier despiste o detalle que demuestre signos de manipulación.

c). Si el rostro, los gestos, el tono de piel o alguna postura no encaja con el resto del cuerpo, es posible que nos encontremos ante un montaje.

La mayoría de los deepfakes se centran en sustituciones faciales, por lo que los cambios en el resto del cuerpo no se aplican y pueden proporcionar pistas.

d). En este tipo de falsificaciones los personajes suelen parpadear poco y en períodos relativamente largos u homogéneos.

c). Si el sonido del vídeo no coincide con la imagen, hay que detectar si existe algún tono fuera de lugar en la voz del protagonista o una falta de sincronización, ya que posiblemente se tratará de una falsificación.

d). Debido al trabajo de edición y los costes, estos vídeos suelen ser cortos.

e). Se debe contrastar la información del vídeo realizando búsquedas en Internet.

f). En caso de que no exista ninguna comunicación oficial, hay que intentar contactar directamente con la asociación o entidad para corroborar la información.

f). Hay que utilizar el sentido común ya que, en ocasiones, estos vídeos intentan distorsionar la realidad o crear alarma entre la sociedad.

SENSACIONES

La mayoría de los «deepfakes» te dejan la sensación de que algo está mal, y eso es porque hay errores en el proceso que dejan residuos.

Los anteriores son algunos puntos clave que se pueden entrenar para que el ojo humano los detecte.

Junto con otras técnicas de verificación de identidad, pueden ayudar a detectar un deepfake[ii].

Desde el INCIBE se proporcionan una serie de recomendaciones referentes tanto a como estar preparado ante un deepfake, como que acciones desarrollar si una persona o entidad es víctima de un deepfake

En este sentido, se señala que como regla general evitar que suplanten con un deepfake no está al alcance de la persona ni de la empresa, más aún en estos tiempos en los que se utiliza la imagen y la voz para todo tipo de acciones comerciales.

No obstante, sí se pueden seguir algunas medidas proactivas para mitigar los daños que podría ocasionar:

a). Monitorizar las redes sociales: es muy importante llevar un control, ya no solo de las menciones a la cuenta de la empresa, sino de los hashtags o localizaciones de la empresa.

b). Establecer un plan de crisis: en caso de que esto suceda, es aconsejable tener preparado un plan para hacerle frente, frenarlo y reaccionar a tiempo y con contundencia.

c). Formar y concienciar al personal para detectar suplantaciones: sobre todo a aquellas personas que trabajan en puestos relacionados con pagos o que gestionan servicios clave para la empresa.

d). Tomar precauciones cuando se usen videoconferencias.

e). Actualizar los procedimientos de pago: de forma que todos los pagos tengan que ser autorizados por correo electrónico o de forma presencial y nunca por teléfono. Además, en caso de ser pagos mayores, que sean autorizados por más de una persona en la empresa.

f). Contratar un seguro: verificando que tenga cobertura ante fraudes basados en deepfake.

En lo que atañe al hecho de si una persona ha sido víctima de un deepfake, en tal caso, los pasos a seguir serían los que se indican a continuación:

a). Solicitar a la cuenta que lo subió que lo borre: si llevamos una correcta monitorización de nuestras redes, podremos enterarnos de estas situaciones al principio y tomar medidas lo antes posible. En este caso, hay que actuar antes de que el vídeo se expanda por las redes sociales.

b). Denunciar lo ocurrido ante las Fuerzas y Cuerpos de Seguridad del Estado (Policía o Guardia Civil) para que los hechos puedan ser investigados. No todos estos casos llegan a ser esclarecidos, pero servirá para poner de relevancia la problemática asociada a estos casos.

c).Notificar el incidente a INCIBE-CERT o ponerse en contacto con Tu Ayuda en Ciberseguridad de INCIBE si se precisa más información sobre este tipo de incidentes.

Las consecuencias del uso de esta tecnología en manos de delincuentes llevará a una proliferación de nuevos delitos a nivel mundial, donde el principal obstáculo es discernir lo que es real, de aquello que constituye una ficción basada en la manipulación y el fraude.

El desarrollo tecnológico aplicado al tratamiento de los videos, de la imagen y de la voz de los seres humanos contribuye poderosamente a la proliferación de este tipo de técnicas, y ello unido a la nueva forma de comunicarse, por ejemplo a través de redes sociales, la suplantación de identidades, o la creación de identidades falsas, todo ello conduce a desinformaciones que tienen todos los visos aparentes de realidad, de muy difícil detección y neutralización, antes de que generen daños irreparables en las personas y a nivel colectivo.

Todo ello exige un esfuerzo normativo global, a los efectos de regular el desarrollo tecnológico de manera ordenada y consciente.

[i] SEON. “Deepfake”

[ii] Cfr.: SEON. “Deepfake”. Obra citada.